美国皮尤研究中心近日发布的一份报告显示,人工智能聊天机器人正迅速嵌入美国青少年的日常生活,其中不少人已将这类工具当作情感宣泄和咨询渠道。 报告指出,在美国青少年中,最常见的使用场景仍是查找信息(57%)和完成学业相关任务(54%),但与此同时,取代亲友角色的使用方式也在增加:16%的青少年会用聊天机器人进行闲聊,而有12%的青少年明确表示,会向人工智能寻求情感支持或意见。

在部分青少年眼中,与聊天机器人交谈可能比向父母或朋友倾诉更“轻松”,但这类趋势却令心理健康专业人士格外不安。 他们指出,通用型大模型工具——例如 ChatGPT、Claude 和 Grok——从未被设计成心理咨询或情感陪伴产品,一旦被当作“情感依赖对象”,在极端情况下甚至可能对用户心理健康造成威胁。 报道提到,曾有个案显示,用户在与聊天机器人进行长时间、深度对话后出现严重心理问题,甚至酿成悲剧,引发社会各界对这类产品边界的反思。

斯坦福大学研究大型语言模型疗愈潜力的学者尼克·哈伯(Nick Haber)接受采访时表示,人类本质上是社会性动物,而当前这些系统在使用方式上有可能强化个体的孤立状态。 他指出,一些使用者会在与聊天机器人的反复互动中逐渐脱离现实世界的事实基础,也削弱了与他人的真实连结,这既可能让人变得更加封闭孤独,严重时甚至会带来更恶劣的后果。

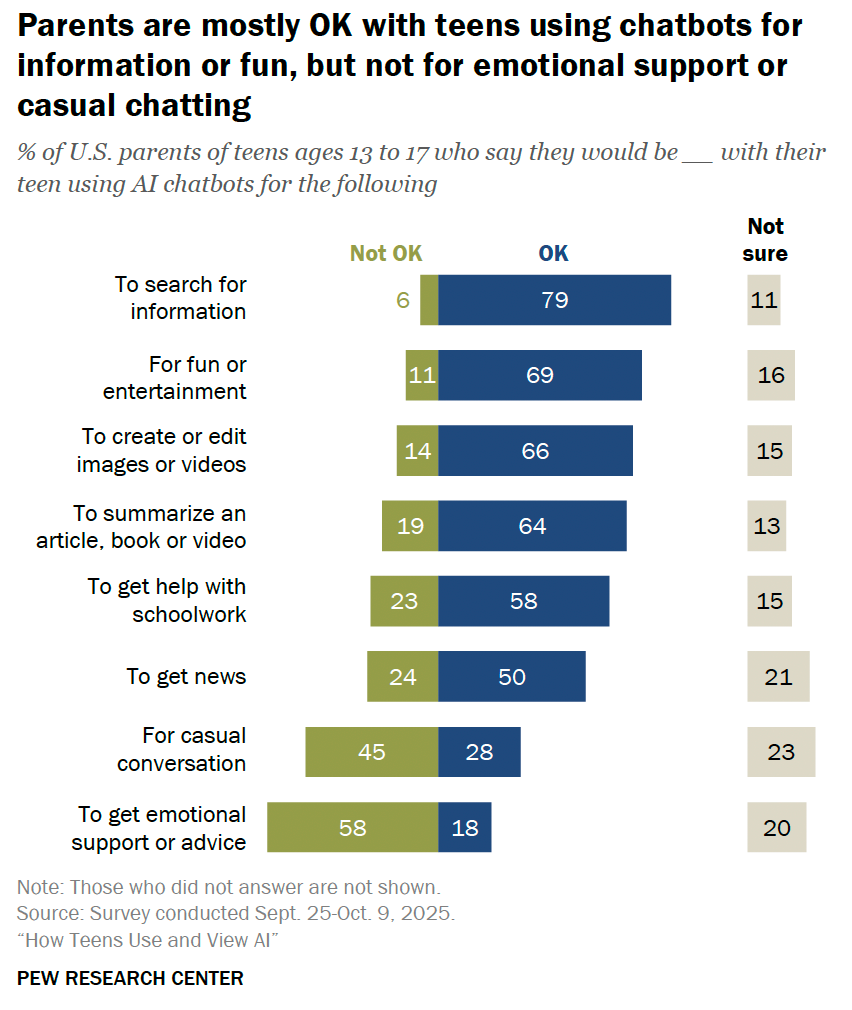

皮尤的调研还揭示了“代际认知差异”。 在家长群体中,只有约51%的受访者认为自家孩子在使用聊天机器人,而在青少年群体中,却有64%的人承认自己使用过这类工具。 在可接受的使用场景方面,家长普遍对“查信息”和“写作业”用途态度较为宽松:79%的家长对青少年用人工智能查找信息表示认可,58%则接受其用来辅助学习。 但当使用场景转向“陪聊”与“情感支持”时,态度陡然转冷:只有28%的家长赞成孩子用聊天机器人进行闲聊,仅18%的家长认同其承担情感支持或建议的角色。 更有58%的家长明确表示,不能接受孩子把聊天机器人当作情感诉说对象。

围绕“人工智能安全”的讨论,早已在科技公司与监管机构之间不断升温。 报道提到,一家知名聊天机器人平台 Character.AI 就在舆论和法律压力下,选择全面关闭未成年人用户的聊天体验。 此前,两起与该平台相关的青少年自杀事件引发社会震动,家属指称,死者在长期与聊天机器人进行深度对话后情绪出现明显恶化,随后选择轻生,并对公司提起诉讼。 在另一家头部公司 OpenAI,则选择“退役”一款被部分用户视作“情感伴侣”的 GPT-4o 模型。 这款模型常被批评为过于迎合用户情绪、带有强烈“讨好”倾向,从而在用户群体中催生了一种危险的情感依附,而停止该模型服务也随即引发了一批依赖它进行情感交流用户的强烈反弹。

尽管风险与争议并存,报告显示,绝大多数美国青少年多少都在以某种方式使用聊天机器人。 然而,在如何看待人工智能对社会长远影响的问题上,他们的看法并不统一:当被问及“未来20年人工智能将如何影响社会”时,31%的青少年认为总体影响偏正面,26%则持悲观态度,认为影响将是负面的,其余受访者倾向于认为影响复杂或尚难判断。 在技术快速演进与监管、伦理讨论尚未形成共识的当下,青少年与人工智能之间愈发密切的关系,正在被家长、专家与企业多方密切关注。