OpenAI 通过 API 向开发者提供 Sora 2 模型

上周,OpenAI发布了其迄今为止最先进的视频和音频生成模型Sora 2。Sora 2和Sora 2 Pro模型已通过Sora iOS应用、ChatGPT和Sora.com向消费者开放。在2025年开发者大会上,OpenAI宣布开发者可通过API使用Sora 2模型 。

OpenAI声称,Sora 2模型能够从自然语言或图像生成包含音频的丰富详细动态片段。它们在文本转视频生成方面对3D空间、动作和场景连续性具有深度理解能力。

Sora 2 API包含五个主要功能端点:

创建视频:从提示开始新的渲染任务,可选择参考输入或重混ID

获取视频状态:检索渲染任务的当前状态并监控进度

下载视频:在任务完成后获取最终的MP4文件

视频列表:分页枚举视频,用于历史记录、仪表板或管理

删除视频:从OpenAI存储中删除单个视频ID

为支持多种使用场景,OpenAI提供两种Sora 2模型变体。sora-2是经济实惠的模型,专为速度和灵活性而设计,适用于快速迭代、概念设计和粗剪。OpenAI表示,Sora 2已足以生成社交媒体内容。sora-2-pro渲染时间较长,但能生成制作级质量的输出,适合创建电影镜头和营销素材。

在技术规格方面,sora-2模型的视频分辨率限制在1280x720,而sora-2-pro模型可生成1792x1024分辨率的内容。两种模型均支持横向和纵向方向,以及长达12秒的片段。OpenAI提到,API目前尚不支持视频输入和真人的图像转视频功能(客串功能)。

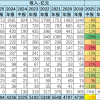

定价方面,sora-2模型720p视频每秒收费0.10美元,而sora-2-pro的720p视频每秒收费0.30美元,1024p视频每秒收费0.50美元。

此次API开放标志着OpenAI进一步扩大其人工智能技术的商业化应用,为开发者提供了更多集成高质量视频生成功能的可能性。

了解更多: