上海交大教授张伟楠:华为昇腾384芯片有望完全和美国抗衡 甚至超越

今日,上海交通大学计算机科学与工程系教授张伟楠在采访中谈及了国产芯片的看法。他表示“我国现在正在走一条新路线,虽然单芯片我们可能不如最顶级的西方芯片,但我们通过芯片去构建出一个超级集群,比如华为昇腾384,有望能曲线救国,能够在集中集成式算力方面和美国抗衡,甚至超越他们。”

随后,他还提到了这两天刚刚出的DeepSeek-OCR,他认为这样的一个模型,在国外也广受好评,它有可能是游戏规则的制定者和变化者。原因在于它的压缩率,是大语言模型的10倍。

随即,他表示(未来5年对中国)会是一个革命性的机会,“无论是那边的一些议员,还是一些顶级大厂的一把手,他们对于中美之间的这个博弈,之间的差距,其实统一认知就是非常非常小的,甚至黄仁勋还称落后了1纳米”。

由此,他分析“所以说在这种情况下,底层芯片带来的弱势,将会在接下来的几年之内,极大地被替代掉,被革命掉。”

官方资料显示,张伟楠博士现任上海交通大学计算机学院教授、博士生导师、院长助理。

他长期担任NeurIPS、ICML、ICLR、KDD等会议领域主席和TPAMI期刊编委,主持国家自然科学基金优秀青年项目和科技部2030新一代人工智能重大项目课题,入选中国科协青年人才托举工程和上海市科委英才扬帆计划,获得吴文俊人工智能优秀青年奖和达摩院青橙奖。

PS:

7月26日,2025世界人工智能大会(WAIC)在上海世博中心启幕,华为首次线下展出昇腾384超节点,即Atlas 900 A3 SuperPoD。

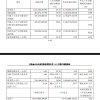

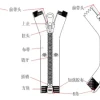

该产品基于超节点架构,通过总线技术实现384个NPU之间的大带宽低时延互联,解决集群内计算、存储等各资源之间的通信瓶颈。

据了解,华为的AI算力集群解决方案CloudMatrix 384,基于384颗昇腾芯片构建,通过全互连拓扑架构实现芯片间高效协同,可提供高达300 PFLOPs的密集BF16算力,接近达到英伟达GB200 NVL72系统的两倍。

此外,CM384在内存容量和带宽方面同样占据优势,总内存容量超出英伟达方案3.6倍,内存带宽也达到2.1倍,为大规模AI训练和推理提供了更高效的硬件支持。

尽管单颗昇腾芯片性能约为英伟达Blackwell架构GPU的三分之一,但华为通过规模化系统设计,成功实现整体算力跃升,并在超大规模模型训练、实时推理等场景中展现更强竞争力。